当記事ではプライサーの研究開発チームによるAIへの取り組みを、連載形式でお届けしています。

シリーズ第2弾は、2Dカメラによる顔認証について、チームのリーダーである「もりにぃ」の話を交えながらお届けします。

研究開発チームがまず最初に取り組んだのは、2Dカメラによる顔認証技術です。

この研究に取り組んだ理由としては2人のAIエンジニアが常日頃から興味を持っていた分野だからというのがあり、コンピュータビジョンをやってみたいという要望もありました。

プライサーの考え方の一つでもある“だめでもいいからやってみよう”もそうですが、とにかくやってみないことには何にも分からないということで、最初はみなさんがよく耳にする、顔認証からトライすることになりました。

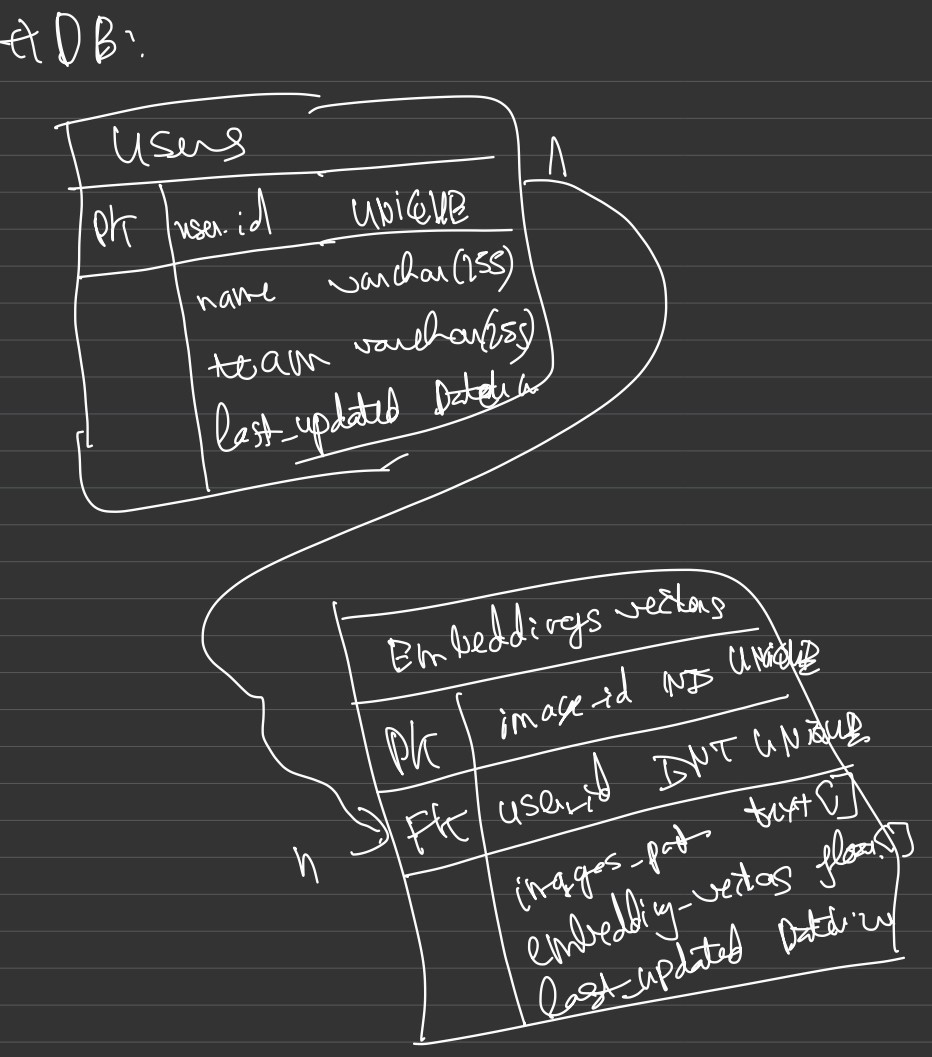

顔認識のプロセス

▲AIエンジニアのトァンさんが作成した「顔認識データベースの概念の最初の証明」

顔認証では、一般的に次のプロセスでモデルを構築します。

①顔検出:画像内で人間の顔を特定し、顔の領域を切り出す

②顔の前処理:顔画像の明るさ、コントラストの調整や、顔画像のリサイズなどを行い、顔認識アルゴリズムに適した形式に変換する

③特徴抽出:切り出された顔画像から、顔の特徴を表すベクトル(特徴ベクトル)を抽出する。これは、顔の形状、肌の色、目や鼻、口の位置などを表す情報を含む

④特徴マッチング:抽出された特徴ベクトルを、既知の顔の特徴ベクトルデータベースと比較し、類似度を計算する

⑤識別・認証:計算された類似度に基づいて、個人を特定(識別)するか、登録された顔情報と照合して本人確認(認証)を行う

⑥結果の出力:識別や認証の結果を出力し、必要に応じてアプリケーションやシステムに結果を提供する

学習データの収集と教師あり学習

モデル構築と並行して、学習データを集めるために、スタッフ約40名分の写真撮影を行いました。正面からの撮影を中心にちょっと左右を向いたりして、バリエーション的には数種類ほどを撮影してデータを集めました。

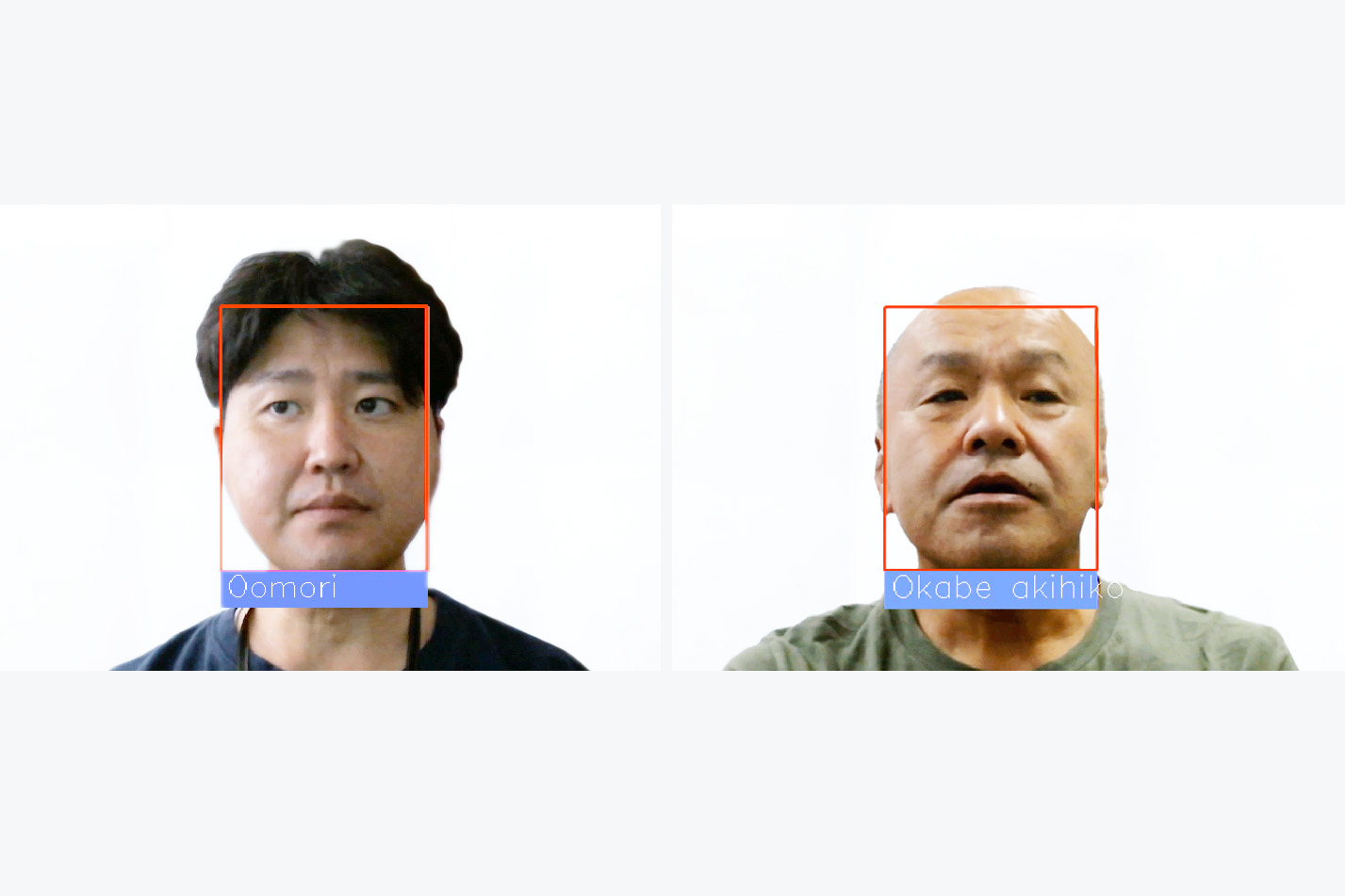

▲左から「Oomori」、「Okabe~」というふうに識別した個人の名前を表示

「これは『教師あり学習』の準備で、データ作成です。撮影後に被写体の方の名前ラベルを作るんですけど、それを教師ありデータと呼びます。

このデータを使って、教師あり学習というトレーニングをAIに施した後で、あらためて被写体の方をカメラで写すと名前が表示される。

学習した内容に関して、これは誰ですか? はい、〇〇さんですと確率的に高いものを表示しているわけです」

テストの結果はトライアルとしてチームが満足できるものでした。

「少なくとも明るい室内で正面から顔を認証させることには成功したので、自社でもできるということがわかりました。

ただ、すでに全体のシステムを統合したカメラ込みのサービスが提供されているので、差別化する必要があります」

顔認証技術の応用~キーワードはライブ認証~

世の中でよく利用されている顔認識技術としては、スマホのロック解除機能があります。特にiPhoneの顔認識(Face ID)はライブ認証といって、実際に持ち主がその場にいないと反応しない仕組みになっています。普通のカメラ画像だけでなく赤外線カメラも一緒に使われており、2つの組み合わせによって本人がいることを確認してから認証を行います。

「私たちが実現できたらいいなと思っていたのは、ノートパソコンに付いているような普通の2Dカメラで、ライブ認証ができる。というところで、優位性が見出せれば。

写真をかざせばクリアできるようなセキュリティの低い物ではなく、その辺のカメラにシステムを組み込むだけでライブ認証が実現できたら何かあるかも? というのは検討していました。

ジェスチャーなど複数の要素で認証するシステムは存在するのですが、なりすましの防止をもっと高い精度で検知できれば応用範囲は広いと思います」

次回は研究開発チームが取り組んでいる、自然言語処理の研究についてお伝えします。